Com evitar que les teves fotos a Instagram i Facebook s'utilitzin per entrenar IA

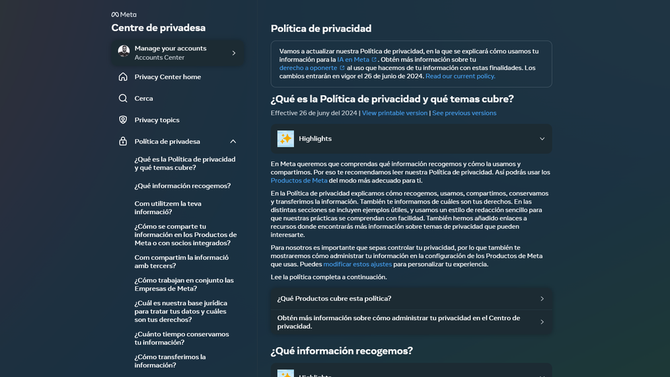

La nova política de privacitat de Meta, que entrarà en vigor el 26 de juny, inclou un apartat on s'explica com es fa servir "la teva informació a la plataforma" per a la IA i sobre el teu dret a oposar-t'hi

Els grans models de llenguatge (LLM) que fan funcionar les eines generatives com ChatGPT necessiten una quantitat ingent de dades per semblar intel·ligents. Tantes, que fins i tot han començat a transcriure milions d'hores de vídeos de YouTube per entrenar-se.

Meta començarà a entrenar els models Meta AI amb publicacions dels seus usuaris si no s'hi oposen. Fotos, textos i, fins i tot, gravacions d'àudio. Això és el que es desprèn de l'actualització dels termes i les condicions d'utilització dels seus productes, concretament la nova política de privacitat, que entrarà en vigor el 26 de juny.

"Actualitzarem la nostra política de privadesa, en la qual s'explicarà com fem servir la teva informació per a la IA a Meta. Obtingues més informació sobre el teu dret a oposar-te a l'ús que fem de la teva informació amb aquestes finalitats."

Els LLM de Meta AI, com les versions de LLaMA, potser estan per sota dels GPT d'OpenAI, o els Gemini de Google en potència i capacitat, però Meta té un avantatge respecte a aquestes dues empreses: la gran quantitat de contingut que generen els seus usuaris. Instagram, Facebook, Threads, Messenger, Quest... productes amb milions d'usuaris que fan publicacions de forma diària.

Pots exercir el dret d'oposar-te que s'utilitzi la informació que has compartit en els seus productes: publicacions, fotos i peus de foto i els mateixos missatges que enviïs a la IA (una pràctica habitual en tots els xatbots intel·ligents).

Per fer-ho, cal omplir el formulari d'Instagram o de Facebook seguint els passos indicats més avall.

La nova política de privacitat menciona els productes on s'aplicaran aquests canvis a partir del 26 de juny: Facebook, Messenger, Instagram (incloses Boomerang i Threads) i altres productes de Facebook com Portal, Meta Quest i serveis com Marketplace, Tendes, Meta Pay o Facebook View, sense mencionar WhatsApp en cap moment.

Cal recordar que l'app de missatgeria més utilitzada del món xifra els continguts que s'hi comparteixen (fotos, vídeos, missatges, notes de veu...), però no fa el mateix amb les preuades metadades: la informació de context sobre on, com, quan i a qui s'envien els missatges.

"No fem servir el contingut dels teus missatges privats amb amics i familiars per entrenar les nostres IA", assegura Meta.

Com oposar-se a la utilització de Meta del nostre contingut

En el primer paràgraf que especifica els canvis de l'actualització de la política de privacitat, Meta indica la possibilitat d'obtenir més informació sobre el nostre "dret a oposar-nos" a l'ús que tenen pensat fer de les nostres aplicacions, una pràctica que aviat farà un any que ja duen a terme en països com els Estats Units.

Fent clic a l'enllaç que indica Meta, se'ns obre un formulari per oposar-nos a l'ús de la nostra informació per "desenvolupar o/i millorar la IA de Meta" en la seva col·lecció de "funcions i experiències d'IA generatives", com Meta AI i altres eines creatives basades en intel·ligència artificial, "així com els models que les alimenten".

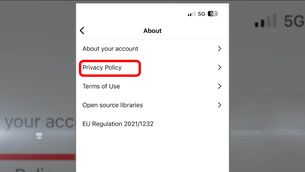

Tant en el cas d'Instagram com en el de Facebook (tots dos serveixen per oposar-s'hi i es poden accedir des dels enllaços inclosos), per accedir al formulari ens obligarà a iniciar sessió i tenir un compte actiu en una de les xarxes socials. També s'hi pot accedir des d'Instagram, a "Configuració i activitat" --> "Informació" --> "Política de privacitat".

En tot cas, completar el formulari no tindrà, obligatòriament, efectes directes ni immediats, ni significarà que Meta respecti la nostra petició. Per començar, aquesta sol·licitud serà subjecte d'una anàlisi:

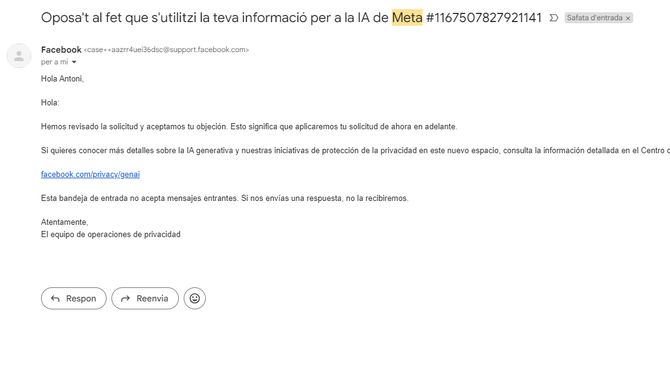

"Revisarem les sol·licituds d'objecció d'acord amb les lleis de protecció de dades pertinents. Si acceptem la vostra, s'aplicarà a partir d'aquell moment."

Darrerament, però, els usuaris comencen a rebre una resposta genèrica de Meta en què s'indica que han revisat i acceptat l'objecció i que això significa que "aplicarem la teva sol·licitud d'ara endavant":

Per altra banda, és possible que Meta continuï processant informació nostra per millorar i desenvolupar els seus models de llenguatge "encara que t'hi oposis" i, fins i tot, encara que no utilitzis els seus productes.

El motiu és, tal com explica la mateixa empresa, que qualsevol altre usuari dels seus productes pot haver penjat una foto nostra o pot haver escrit una publicació o peu de foto que menciona dades personals que ens pertanyen.

El control de la nostra informació en els productes de Meta, doncs, no està a les nostres mans i l'empresa fundada per Mark Zuckerberg, novament, pretén desentendre's de qualsevol responsabilitat sobre el seu ús.

El formulari inclou quatre apartats:

- País de residència (obligatori): apartat en què hem d'indicar el nostre país de residència i que servirà per aplicar les lleis de protecció vigents en cada regió.

- Adreça electrònica (obligatori): espai per identificar el nostre correu electrònic associat al compte que tenim a Meta.

- Com t'afecta aquest processament (obligatori): bloc per exposar els motius pels quals ens volem oposar a l'ús de la nostra informació personal per entrenar, desenvolupar i millorar els models d'IA de Meta.

Alguns experts recomanen deixar-hi ben clara la nostra oposició explícita i fer referència a l'instrument legal que ens protegeix, el RGPD, amb un text similar al següent:

"Em nego explícitament que la meva imatge sigui tractada, processada o utilitzada per entrenar la intel·ligència artificial, i exigeixo que es respectin els meus drets definits en el Reglament General de Protecció de Dades".

- Informació addicional: apartat opcional on podem afegir més informació que pugui ser rellevant per donar suport al nostre cas i acabar de convèncer Meta perquè ens accepti l'objecció.

Un cop emplenat el formulari, per poder-lo fer arribar a Meta, l'empresa ens enviarà i sol·licitarà un codi de verificació per confirmar que no estem suplantant la identitat del propietari del compte, un procés rutinari de seguretat en l'autenticació en dos passos.

Demanar perdó, no permís

L'origen del corpus de continguts utilitzats per entrenar els grans models generatius, ja siguin de text, imatge, vídeo o àudio, és un dels aspectes més polèmics d'aquestes noves eines, a part de la seguretat dels continguts que generen.

Els drets sobre el contingut utilitzat per alimentar les IA ha estat motiu de múltiples litigis i denúncies públiques, amb The New York Times com un dels casos paradigmàtics i Scarlett Johansson com un dels més recents.

Els canvis en la política de privacitat de Meta tornen a demostrar que les grans tecnològiques estan immerses en una guerra pel desenvolupament de grans models de llenguatge cada cop més potents. No semblen tenir cap mirament en cap dels aspectes que més preocupen els experts en la seguretat de productes basats en intel·ligència artificial.

Mentre que un dels líders en aquesta tecnologia, OpenAI, no para de ser protagonista de titulars sobre moviments que fan perillar les seves mateixes mesures de seguretat i diversos responsables de protegir-la abandonen l'empresa, els grans experts adverteixen que el sector es mou massa ràpid i sense prou garanties, assumint, fins i tot, "riscos extrems".