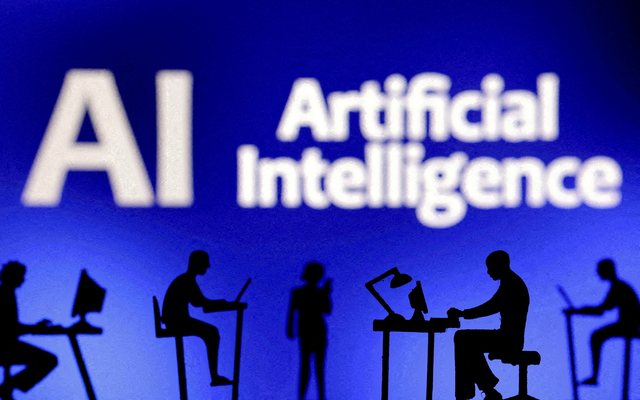

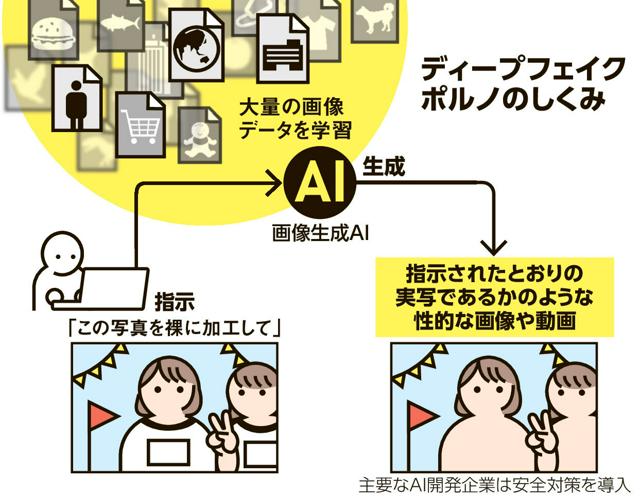

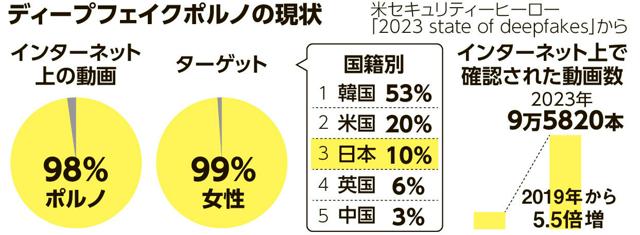

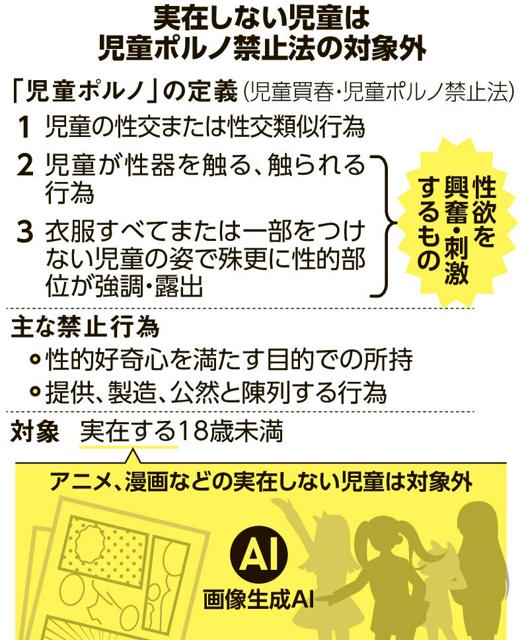

AI(人工知能)を使って偽の性的な画像や動画を作る「ディープフェイクポルノ」。身近な人をターゲットにした被害が広がっている。

米ニュージャージー州の高校では昨年10月、少なくとも女子生徒30人の「裸画像」が学校内で出回っていることが発覚した。

「こんなことが自分の身に起こるなんて考えもしなかった。どうしたらいいのか分からず、ショックでただ泣いていた」。被害者の一人、フランチェスカ・マニさんは話す。

作成したのは、同級生の男子生徒だった。SNS上の画像を「服を脱がすAIアプリ」を使って加工し、他の生徒らと共有していたという。

マニさんが不信感をいだいた…

【初トクキャンペーン】有料記事読み放題!スタンダードコースが今なら2カ月間月額100円!詳しくはこちら

![ニュースの要点[object Object]](http://www.asahicom.jp/imgopt/img/3605dc0da0/hd640/AS20241226004124.jpg)

![ニュースの要点[object Object]](http://www.asahicom.jp/imgopt/img/db9d8d05ba/hd640/AS20241225003050.jpg)

![ニュースの要点[object Object]](http://www.asahicom.jp/imgopt/img/5b5c595c7b/hd640/AS20241224003442.jpg)

![ニュースの要点[object Object]](http://www.asahicom.jp/imgopt/img/f7a74dffe0/hd640/AS20241223003962.jpg)

![ニュースの要点[object Object]](http://www.asahicom.jp/imgopt/img/ae4df9a3be/hd640/AS20241222002908.jpg)